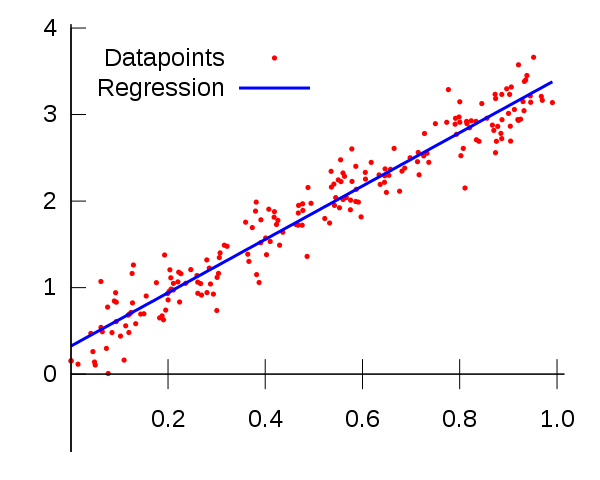

Qu'est-ce que l'indicateur de régression linéaire MT4 ?

La régression linéaire a été le premier type d’analyse de régression à être étudiée rigoureusement et à être largement utilisée dans des applications pratiques. En effet, les modèles qui dépendent linéairement de leurs paramètres inconnus sont plus faciles à ajuster que les modèles qui ne sont pas liés de manière linéaire à leurs paramètres et parce que les propriétés statistiques des estimateurs résultants sont plus faciles à adapter. C’est plus facile à déterminer.

En statistique, la régression linéaire est une approche linéaire pour modéliser la relation entre une variable dépendante scalaire y et une ou plusieurs variables explicatives (ou variables indépendantes) notées X. Le cas d'une variable explicative est appelé régression linéaire simple. Pour plus d’une variable explicative, le processus est appelé régression linéaire multiple. (Ce terme est distinct de la régression linéaire multivariée, où plusieurs variables dépendantes corrélées sont prévues, plutôt qu'une seule variable scalaire.)

Dans la régression linéaire, les relations sont modélisées à l'aide de fonctions prédictives linéaires dont les paramètres de modèle inconnus sont estimés à partir des données. Ces modèles sont appelés modèles linéaires. Le plus souvent, la moyenne conditionnelle de y étant donné la valeur de X est supposée être une fonction affine de X ; moins fréquemment, la médiane ou un autre élément de la distribution conditionnelle de y étant donné X est exprimée comme une fonction linéaire de X. Comme toutes les formes d'analyse de régression, la régression linéaire n se concentre sur la distribution de probabilité conditionnelle de y étant donné X, plutôt que sur la distribution de probabilité conjointe de y et X, qui est le domaine de l'analyse multivariée.

La régression linéaire a de nombreuses utilisations pratiques. La plupart des applications appartiennent à l'une des deux grandes catégories suivantes :

Si l'objectif est la prédiction, la prévision ou la réduction des erreurs, la régression linéaire peut être utilisée pour adapter un modèle prédictif à un ensemble de données observées de valeurs y et X. Après avoir développé un tel modèle, si une valeur supplémentaire de X est ensuite donnée sans la valeur qui l'accompagne de y, le modèle ajusté peut être utilisé pour faire une prévision de la valeur de y.

Étant donné une variable y et un certain nombre de variables X1,…, Xp qui peuvent être liées à y, une analyse de régression linéaire peut être appliquée pour quantifier la force de la relation entre y et le Xj, pour évaluer lequel Xj peut n'avoir aucun lien avec y du tout, et pour identifier quels sous-ensembles du Xj contiennent des informations redondantes sur y.

Les modèles de régression linéaire sont souvent ajustés en utilisant l'approche des moindres carrés, mais ils peuvent également être ajustés d'autres manières, par exemple en minimisant le « manque d'ajustement » dans une autre norme (comme avec la régression la moins absolue), ou en minimisant un pénalisé version de la fonction de perte la plus faible, comme dans la régression de crête (pénalité de norme L2) et le lasso (pénalité de norme L1). À l’inverse, l’approche la moins risquée peut être utilisée pour s’adapter à des modèles qui ne sont pas des modèles linéaires. Ainsi, bien que les termes « moindres carrés » et « modèle linéaire » soient étroitement liés, ils ne sont pas synonymes.